最近两天,AI圈有点不太对劲。不是谁又发了一个更大的模型,也不是算力又刷新纪录,而是一个更微妙、也更危险的信号——有人开始动Transformer最底层的结构了。

Elon Musk 在X(推特)上转发了一篇来自中国的论文,只写了一句很克制的话:“Impressive work from Kimi。”(Kimi的作品令人印象深刻)看起来轻描淡写,但熟悉这个圈子的人都明白,这种级别的人物,很少为“普通优化”亲自站台。更耐人寻味的是,月之暗面(Moonshot AI)的Kimi团队几乎秒回了一句:“你的火箭造得也不错。” 这不像简单互动,更像是一种带着锋芒的回应—— 我们不只是追赶,我们已经开始改规则。紧接着,Andrej Karpathy 也下场评论,说了一句意味很深的话:“ 我们对《Attention is All You Need》的理解,可能还远远不够。” 如果说马斯克是在点赞,那这句话更像是在承认一个事实:Transformer,也许并没有被真正吃透。问题其实也就摆在这儿了:一篇既没有发布新模型、也没有刷榜、甚至没有堆参数的论文,为什么能让整个硅谷集体停顿一下?答案并不复杂——它动的,是Transformer里最“不能动”的一块:残差连接。

如果你把神经网络想象成一本越来越厚的教科书,就很好理解这个问题。每往后翻一页,内容都会变得更复杂,而传统网络的一个问题在于,前面学到的重要信息,很容易在后面的层层计算中被冲淡甚至遗忘。就像你读到第100页时,前面第1页的关键公式,早就模糊了。

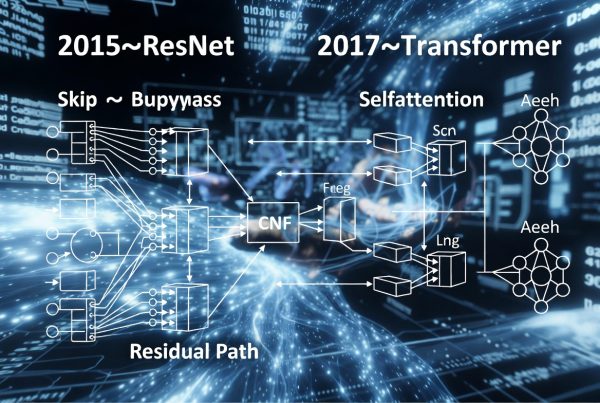

2015年,残差网络(ResNet)解决了这个问题。它做了一件非常简单的事情:每一层的输出,不只是当前计算结果,还要加上原来的输入。看起来只是“多加了一步”,但效果却非常直接————信息不再轻易丢失,网络可以变得更深,训练也更稳定。如果换个更生活化的比喻,它就像高速公路旁边始终存在的一条直达通道,无论主路多复杂,起点的信息总能被送到终点。

2017年,Transformer诞生,这套机制被完整继承下来,成为今天几乎所有大模型的基础。从ChatGPT 到Kimi,再到DeepSeek,本质上都建立在同一套逻辑之上:残差负责让信息“不丢”,注意力负责让模型“会选”。这套组合稳定运行了很多年,几乎没人质疑。 但问题也恰恰出在这里。当模型越来越深,残差连接开始表现出一种不那么直观的副作用。你以为它在帮你“记住”,实际上,它更像是在不断“稀释”。

还是那本教科书的比喻。如果你每一页都要把前面所有内容重新加一遍,听起来像是在强化记忆,但现实是,最早的重要信息,会被后面越来越多的内容冲淡。第一页的一个关键结论,在第100页时,已经被平均稀释了99次。就像一群人传话,最开始那句“我爱你”,传到最后,往往变成一句模糊不清的话。这就是所谓的“稀释效应”。它带来的影响,不只是精度下降,而是更深层的结构问题:模型在需要回头看历史信息的任务上表现变差,隐藏状态的数值不断膨胀,训练变得不稳定,算力投入越来越大,但收益却没有同步提升。换句话说,残差连接并没有真正增强记忆,它只是让遗忘发生得慢一点。

这个问题其实并不新鲜,但一直没人敢动。因为残差连接不是一个可以随便替换的小组件,它是整个架构的“骨架”。改对了是革命,改错了就是全盘崩掉。而Kimi团队做的事情,恰恰就是在这个位置动刀,而且方法出奇地简单。他们没有推翻原有结构,而是换了一种思路:既然注意力机制在处理序列信息上已经证明了自己,那为什么不能用在“层与层之间”? 传统残差的逻辑,是把所有历史信息一股脑加起来,每一层的权重都是一样的。而他们提出的Attention Residuals,本质上是给每一层加了一个“筛选器”,让模型自己决定,哪些历史信息更重要,哪些可以忽略。于是,原本的“无脑叠加”,变成了“按需调用”。

如果继续用写书来打比方,过去的做法是每写一章,就把前面所有章节全部复印一遍叠进去;现在则更像是你手里多了一个智能检索系统,只把真正相关的内容提取出来加入当前章节。重要的部分被强化,不重要的部分自动被过滤掉。这件事的关键不在于“更复杂”,而在于“更聪明”。信息不再是全部保留,而是被选择性地使用。更现实的一点是,这种改动并没有带来明显的成本负担。通过分块的方式,他们让这种“注意力残差”只在部分层之间发生,从而把内存和计算开销控制在一个很低的范围内。推理延迟几乎没有明显增加,但效果却得到了保留。这意味着,它不是一个实验室里的想法,而是可以直接落地的结构替换。从实验结果来看,这种改动带来的并不是“微小优化”,而是效率层面的变化。在相同算力下,模型整体效率提升大约25%,在推理、数学、代码等需要回溯信息的任务上表现尤为明显。与此同时,训练过程更加稳定,数值不再无序膨胀,深层模型终于变得可控。

这也是为什么这件事会同时引起Elon Musk和Andrej Karpathy的关注。因为它触及的不是能力边界,而是结构认知。过去大家默认注意力只应该用在token之间,而这篇论文等于把它扩展到了另一条维度上,让“层之间的关系”也变成可以学习、可以选择的对象。某种程度上,这相当于在告诉整个行业:我们过去对Transformer的理解,可能只是一个起点,而不是终点。更有意思的是,这篇论文的共同一作之一,是一位17岁的高中生。这个细节本身就足够有传播力,它说明一件事——在这个领域里,决定上限的,未必是资历,而是你有没有抓住那个真正重要的问题。

从行业角度来看,这件事的意义也很清晰。

第一,是算力效率的重新定义。在今天的AI世界里,算力几乎等同于资源,如果一个结构能直接节省20%以上的计算量,那带来的不仅是成本下降,更是竞争力的提升。

第二,是对未来智能体能力的铺垫。越复杂的任务,越依赖对历史信息的理解和整合,而这种结构正好强化了这一点。

第三,是路线的变化——当很多人还在比谁的模型更大时,已经有人开始重新设计“发动机”本身。

回过头看,这篇论文真正重要的地方,并不在于它提出了一个多复杂的技术,而在于它改变了一种默认前提:信息不需要全部保留,关键是如何选择。

11年前,《Attention is All You Need》改变了AI的发展路径,而今天,这种思路似乎正在被进一步延伸。Attention本身没有变,但它的使用方式变了,从“局部选择”变成了“跨层选择”。

也许未来的模型,不一定更大,但一定更“会挑”。

而对普通人来说,理解这一点其实已经足够了:AI的进步,正在从“堆规模”,慢慢转向“改结构”。当越来越多这样的改变出现时,你会发现,真正拉开差距的,往往不是谁跑得更快,而是谁先看懂了规则本身。